Ordinateur

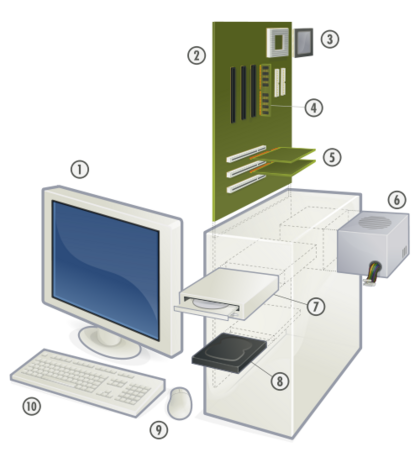

Un ordinateur est un appareil électronique capable de réaliser rapidement des opérations mathématiques, logiques, des manipulations de chaînes de caractères ou des recherches. Il est composé de deux grandes parties :

- L'unité centrale, enfermée dans un boîtier, où se trouve notamment la carte mère, et le processeur, qui est le centre de calcul ;

- Les périphériques d'entrée ou de sortie : on y classe le clavier, le disque dur, le lecteur de CD ou de DVD, la souris, le moniteur, l'imprimante, le scanner, etc..

Historique[modifier | modifier le wikicode]

Au XVe siècle, on utilisait déjà le mot « ordinateur », mais au sens de « celui qui institue quelque chose ». C'est au XXe siècle qu'il a pris son sens actuel. Il vient du latin ordinator (« celui qui règle, met en ordre ; ordonnateur »)1. L'ordinateur a été inventé pour aider les scientifiques à calculer. Et le terme d'ordinateur a été proposé pour remplacer celui de calculateur en 1955, par le latiniste Jacques Perret (professeur à l'université parisienne de la Sorbonne), à la demande de l'entreprise IBM2. Il ne convenait plus car les ordinateurs modernes faisaient bien plus que du simple calcul. Ce terme se répandit vite parmi les utilisateurs et, en 1965, devint un nom commun3.

Origine[modifier | modifier le wikicode]

Dès la préhistoire les humains comptent (os d’Ishango). Leur besoin est limité et l’idée de nombre suffit avec un, deux, trois et plusieurs. Mais au néolithique avec l'agriculture, les villes et la multiplication des échanges, ils ont besoin d’un support pour compter. En Mésopotamie ils utilisent les calculs, des jetons d’argile. Plusieurs systèmes de numération se développent dans le monde. Ils utilisent l’écriture et représentent chaque unité, puis chaque chiffre par des symboles. Ces symboles sont différents selon les pays et les époques (chiffres romains, arabes...).

L’utilisation de l'arithmétique, les 4 opérations : addition, soustraction, multiplication et division, devient de plus en plus fréquente. Des supports pour s'aider à calculer deviennent nécessaires. Ils prennent la forme de bouliers dès l'Antiquité, de tables (livres des comptes faits par Monsieur Barrême au XVIIème siècle, sous le règne de Louis XIV) ou de règles à calculer. Elle est inventée en 1630 et utilisée jusqu'à l'invention des calculatrices électronique dans les années 70.

L'étape suivante est la machine à calculer au XVIIème siècle avec les modèles de Schickard, Pascal et Gottfried Leibniz. Ceux sont les premiers supports automatisant la retenue, ils se basent sur le développement de la roue dentée utilisée en horlogerie. La roue dentée est gardée comme base mécanique pour construire de nouveaux instruments de calcul jusqu'au XXème siècle. L’amélioration vient avec l'invention des diodes (ampoule à vide) qui vont permettre de faire des calculs plus rapides que les appareils équipés de roues dentées. Le supercalculateur ENIAC, construit en 1945, fonctionne grâce à des diodes. Cette machine pèse 30 tonnes, mesure 24 m de long pour 5 m de haut, et fait 5000 additions ou 330 multiplications par seconde. Même si l'ENIAC a une capacité de calcul très importante, il n'est pas un ordinateur car il n'a pas le même modèle de construction.

C'est en 1945 que John Von Neumann décrit une machine entièrement nouvelle. C'est un calculateur à programme enregistré dans les circuits de l'ordinateur. Il s'inspire des travaux de deux mathématiciens anglais : Charles Babbage au XIXème siècle (inventeur de la machine analytique) et Alan Turing au XXème. Le programme donne les instructions que doit suivre l'ordinateur. Les machines précédentes avaient des programmes par cartes perforées, une invention de Jacquard pour les métiers à tisser en 1804.

Le premier ordinateur est commercialisé en 1951 s'inspirant du Manchester Mark I. Il fonctionne encore avec des diodes. La taille des machines diminue beaucoup quand les diodes sont remplacées par des transistors inventés en 1947. Les transistors sont remplacés par des circuits intégrés (inventés en 1958), puis par des microprocesseurs (1971). Le microprocesseur est une puce qui sur 10 mm2 contient 2300 transistors soit la même puissance que l'ENIAC. Au fur et à mesure des innovations les ordinateurs deviennent : plus petits, plus rapides, moins chers. Au travail comme à la maison, l'ordinateur prend place sur le bureau, il devient individuel « PC (Personnal Computer) ». Il y a de nombreuses marques d'ordinateur comme Apple, Asus, Toshiba, HP...

Différents types d'ordinateurs[modifier | modifier le wikicode]

Il y a plusieurs types d'ordinateurs, ils peuvent être classés selon leur taille.

Le mot "PC" veut dire "Ordinateur personnel" ("Personal Computer" en anglais). Un PC peut être un ordinateur de bureau, ou bien un ordinateur portable, conçu pour pouvoir être facilement transportable et disposant d'une batterie. Mais il n'y a pas uniquement les ordinateurs personnels, il existe d'autres types d'ordinateurs, comme les superordinateurs, qui sont des ordinateurs de grande taille, extrêmement puissants, qui sont conçus pour effectuer des calculs très complexes, par exemple pour faire de la recherche scientifique.

Applications[modifier | modifier le wikicode]

Aujourd'hui on utilise les ordinateurs pour des choses très différentes : écrire des textes, jeux vidéo, Internet... Toutes ces fonctionnalités sont permises par des applications ou des utilitaires qui sont deux différents types de logiciels.

La création d'un logiciel se fait par l'écriture d'un programme. Le code source est écrit dans un langage compréhensible par des humains. C'est lui qui fournit l'ensemble des instructions nécessaire à l'ordinateur, son programme. Ces instructions sont traduites en code machine, suite de 0 et de 1, le langage binaire. Le code machine est toujours visible, disponible pour les utilisateurs, mais incompréhensible. Le code source peut être gardé secret par son programmateur ou laissé à la libre disposition de ses utilisateurs.

Quand il est possible d'utiliser, de partager, d'étudier et de modifier librement le logiciel, il s'agit d'un logiciel libre (Linux) et pas d'un logiciel propriétaire (Windows).

Anecdotes[modifier | modifier le wikicode]

Le Bug[modifier | modifier le wikicode]

Le terme anglais "bug" désigne depuis la fin du XIXème un dysfonctionnement, une panne. Il est également utilisé pour les programmes, qui pourtant ne peuvent pas avoir de panne, uniquement des fautes de frappe comme tout autre texte.

Le 9 novembre 1947, le Mark II, un super calculateur de Harvard se mit soudainement en panne. Après recherche, Grace Hopper, une informaticienne, découvrit une mite qui s'y était coincée, le premier bug (insecte en anglais) de l'histoire à être identifié.

Richard Stallman et l'imprimante[modifier | modifier le wikicode]

Richard Stallman travaillait comme informaticien au MIT dans les années 80. L'imprimante du bureau tombait souvent en panne, heureusement il était possible d'accéder au code source de son pilote (logiciel) et de le modifier pour régler le problème. Au changement de la machine, la même panne arrivait mais seul le code machine (binaire) était accessible et il est incompréhensible. R. Stallman et les autre informaticiens veulent changer le code source mais le fabricant de l'imprimante refuse de le donner (logiciel propriétaire). Il réalise le danger des logiciels propriétaires et décide de s'investir pleinement dans la création de logiciels libres, comme GNU/Linux.

Articles liés[modifier | modifier le wikicode]

- Unité centrale ;

- Carte mère ;

- Mémoire de l'ordinateur.

- Dell

- Apple

- Microsoft Windows

- Périphérique (informatique)

- Fenêtre d'édition

- Media-Saturn-Holding

Références[modifier | modifier le wikicode]

- ↑ Dictionnaire de l'Académie française, neuvième édition (1986).

- ↑ ABC de la languefrançaise, de Gilles Boulard (Rouen, France)

- ↑ ABC de la langue française

Bibliographie[modifier | modifier le wikicode]

- Emmanuel Lazard et Pierre Mounier-Kuhn, Histoire Illustrée de l'Informatique (2016), EDP Sciences.

| Les composants de l'ordinateur | ||||||||

| Unité centrale | Périphériques | |||||||

| Carte mère | Mémoire | ROM BIOS | Cartes d'extension | Moniteur | Disque dur | Imprimante | Souris | Clavier |

|